人妖 wordpressseo属于技术还是营销

骨传导耳机之所以能够成为当下最火的耳机,骨传导技术将声音转化为震动感,通过骨头进行传播,不会堵塞耳朵,就不会影响到周围环境音。这种技术也让骨传导耳机比传统入耳式耳机更安全,无需入耳式设计,避免了传统入耳式耳机佩戴的不适感。如今,骨传导已经成为了一个比较火的产品,那么问题来了,骨传导耳机那么多,我们在挑选的时候应该注意哪些方面呢?

1、佩戴舒适度

运动的时长不是一时半会的,而如果佩戴没多长时间,耳朵就出现不适或者是有明显痛感的状况,则证明这款耳机舒适度不够好!舒适度是耳机最基本的参数之一,舒适度好也决定着被使用的次数!而舒适度不好的话,可能戴一两次就搁置了,没有使用价值!

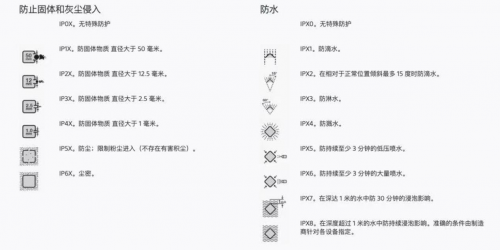

2、防水等级

运动时流出的汗水很容易损害耳机,为了避免这个情况,运动耳机都设有比一般耳机高的防水等,来避免汗水的入侵,延长耳机的寿命。一般来说IPX4以上就可以达到一定的防汗效果,等级越高,防水能力也越强,最高的IPX8等级是可以游泳使用的。

3、续航时长

运动耳机这种日常使用的电子设备来说,耳机的续航时长还是蛮重要的,长时间的续航时间可以解决很多运动群体用户的困扰,毕竟续航决定关键体验。

4、蓝牙只要是无线耳机都是需要蓝牙去连接的,因此蓝牙版本越高连接越稳定,简单来说就是加强的天线,比如你遇到多人的地方或者过红绿灯信号会被干扰,选择高的蓝牙版本,就会最大限度的降低外界干扰。一般选择5.0以上蓝牙,可以确保我们耳机的连接稳定性。

5、音质

音质方面,看自己是想要偏低音的还是高音的,一般骨传导耳机跟普通耳机的音质差距会大一些,而且每个人对音质的要求都是不一样的,所以还是以自己的感觉才好。

1、南卡Runner Pro4骨传导耳机

NANK南卡耳机是骨传导中比较有代表的品牌,凭借着独具的骨振子核心技术,是目前国产骨传导TOP1品牌!南卡Runner Pro4骨传导的优势是享受音乐的时候双耳是开放的,在户外可以快速灵敏的感知周围环境,在复杂不适合塞耳的环境下,骨传导的听歌方式更为安全。

南卡Runner Pro4具备着最完善的功能配置,挂耳的设计佩戴舒适稳固,让你体验最高的运动快感!自带16GB机身内存,支持MP3模式使用!创新型蓝牙5.3技术具有更强的抗干扰性,并还支持10个小时的续航!

在防水防汗方面具有IP68的防水,支持水下三十米潜水使用!机身加入了OT闭合防漏音3.0技术,对于骨传导耳机的漏音处理技术拔尖!并搭载了全新的AF全震指向性振子2.0升级版本+南卡高效能響科技振子技术!在增强立体感的基础上,提升了47%音乐空间,打造出立体颅腔音质的效果,激发你的运动潜能!

2、韶音OpenRun Pro骨传导耳机

韶音这款运动耳机在续航方面对比上一代有了不错的升级,可以达到接近十小时的续航。耳机在音质上也有一定的升级,最突出的就是低音上,明显比上一代强了不少,更加符合运动需要的音乐节奏。耳机机身材质则是采用了钛合金设计外层包裹了亲肤的硅胶,佩戴贴在耳朵上非常细腻舒适,运动的时候不会有太大的负担,牢固性也不错。耳机防水方面是IP55的级别,不算是很高但是防汗是完全够用。

3、飞利浦A6606骨传导耳机

飞利浦这款A6606整体设计比较简约,机身主体是钛合金材质的,外表采用硅胶材质,非常亲肤,在佩戴上面不算很轻盈,但佩戴是很稳固。

音质方面配备了一个15mm的骨传导动圈振子,采用双弹片结构,声音保真。

耳机加入了蓝牙5.2的芯片且支持9小时的续航时间,耳机具有IP67的防水性能,可以有效防止汗水侵袭,也能直接用水龙头冲洗,最重要的是耳机设有贴心的夜光灯,夜间户外跑步的时候耳机能起到警示作用,这款耳机对于又夜跑运动的朋友,非常合适。

4、逸鸥PEACE真无线骨传导耳机

这款骨传导耳机的佩戴方式有点不一样,是直接夹在耳朵上的,佩戴舒适性一般,戴久会有酸痛感,对耳朵敏感的人群不是很友好。它的音质还是不错的,声音人声清晰。但有一点就是漏音问题,没有处理很好,防漏音技术还不是很成熟。它的防水性能达到7级,虽然不能做到在游泳时佩戴使用,但也比很多骨传导耳机的防水性能高。续航时间搭配充电仓,可以使用12小时。这款骨传导耳机总的来说还是可以的,就是价格方面有点高。

5、南卡Runner CC3骨传导耳机

这款CC3采用了机身采用了全钛合金机身骨架和亲肤的航空级别的材料,28g的超轻重量,轻盈小巧,佩戴一天毫无压力。

音质采用了新一代的骨传导技术,搭配14.5MM超大寸振子,声音更加带感,搭配和旗舰一样的OT闭合防漏音技术3.0技术,进一步实现防漏音效果。

配置方面,耳机设有4G内存,可作为独立的MP3使用;IPX6级的防水,无惧汗水雨水,淡定从容。制定蓝牙5.3芯片,连接更加稳定。8小时的续航时间,长时间运动也完全够用,耳机还支持通话降噪功能,在运动过程中,也能保持通话清晰。性价比非常高,初入骨传导运动耳机,预算不多的可以考虑这款。